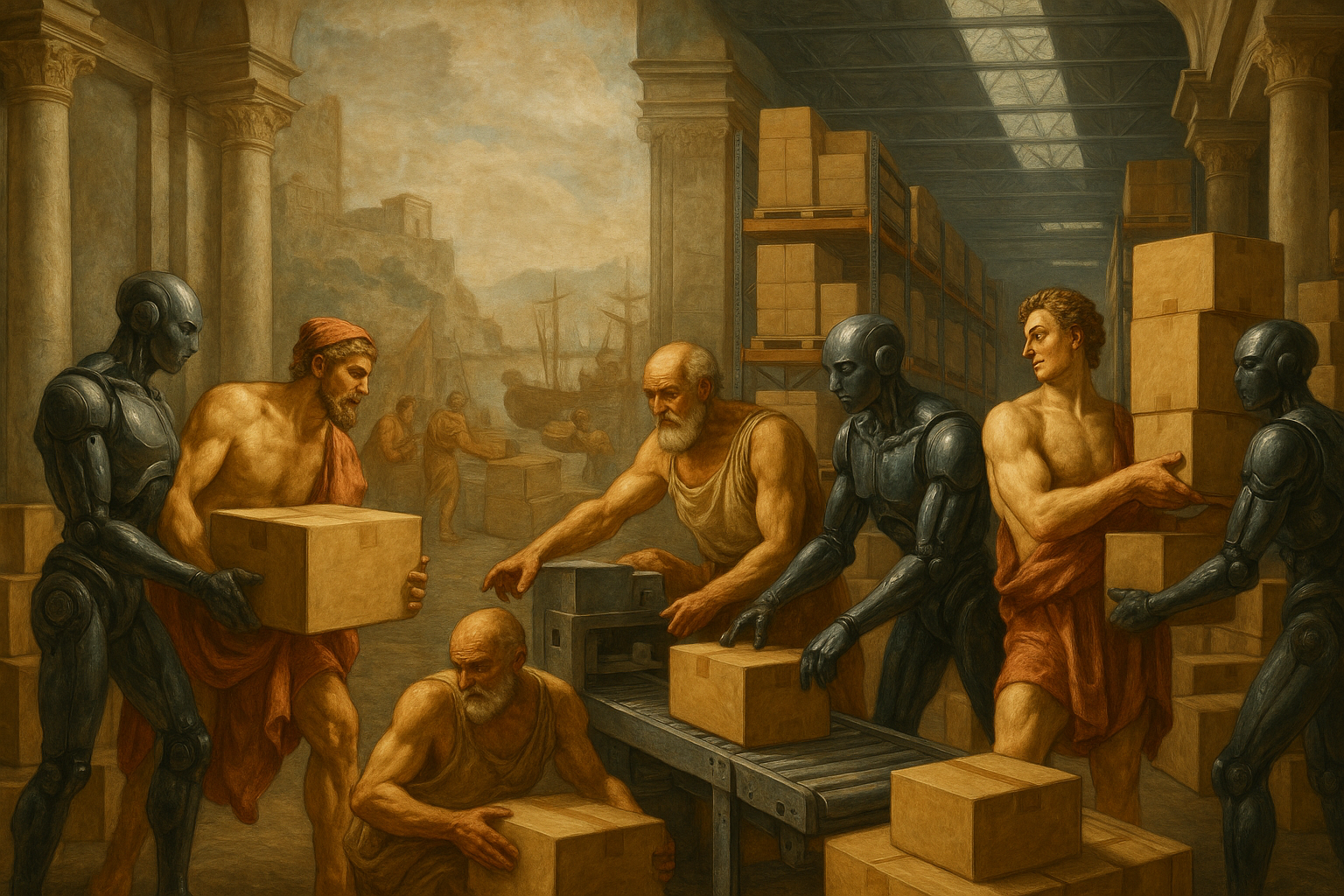

Yapay zekanın geçmişi ve gelişimi çoğu zaman “zekanın evrimi” gibi sunulur. Oysa yapay zekâ dediğimiz olgu sunulduğundan çok daha farklı bir şekilde gelişmiştir. 1642’de Blaise Pascal’ın mekanik hesap makinesiyle başlayan süreç, 1837’de Ada Lovelace ve Charles Babbage’ın programlanabilir makine hayaline; 1943’te McCulloch ve Pitts’in nöral ağ temellerine; ardından 1950’de Alan Turing’in meşhur testiyle makinenin düşünebilirliğine dair ilk kuramsal adımlara uzanır. İlk kez 1955’te “yapay zekâ” adını alan bu olgu, bugün üniversite derslerinden sürücüsüz araçlara, bütün bir lojistik sektörünün yeniden doğuşuna kadar hayatın her alanında görünüyor. Fakat bu devasa ilerlemeye rağmen, bu teknolojiler sanılanın aksine insan gibi “düşünen” değil, istatistiksel örüntüler üzerinden karar veren sistemlerdir. Öyle ki zekâdan çok, hesap gücünün tarihidir bu ve tam da bu noktada şu soruyu sormak gerekir:

Gerçekten bir aklın izini mi sürüyoruz, yoksa yalnızca veriye boyun eğen bir düzenin mi?

Amerika Birleşik Devletleri’nde yapılan bir araştırmaya göre Amerikalı yetişkinlerin yalnızca %10’u yapay zekânın günlük yaşamda artan kullanımına “heyecan” duyduğunu belirtirken, %52’si “endişe” duyduğunu ifade ediyor. 2021’de %37 olan endişe oranının, son iki yılda %52’ye çıkarak önemli ölçüde arttığı görülüyor. Bu noktada toplumu endişelendirmesinin sebepleri çeşitli olsa da genel kanı “insan zekasını alt edecek bir yapay zekanın” hepimizi işimizden edecek olması gibi görünüyor.

Tüm bu korkuların arasında gözden kaçan asıl mesele ise şu: Yapay zekâ biz fark etmeden sıradanlaşıyor. Yapay zekâ sıradanlaştığında artık “yapay zekâ” olarak adlandırılmıyor. Bugün e-posta kutumuzdaki spam filtreleri, dijital haritaların trafik tahminleri ya da kargomuzu yönlendiren algoritmalar, teknik olarak aslında birer yapay zekâ ve sürekli çalışıyorlar. Ama hiçbirimiz bu uygulamaları yapay zekâ olarak düşünmüyoruz. Çünkü günümüzde yapay zekâ kelimesi sadece “olağanüstü” olanla özdeşleşmiş durumda; gündelikleştiğinde ise görünmezleşiyor. Diğer bir deyişle bir kez alışıldığında artık sorgulanamaz bir sıradan haline geliyor. Belki de gelecekte işlerimizi kaybetmek, bugünkü gibi sorgulanan bir durum değil; aksine, o dönemin sıradan kabul edilen bir normu olacak. En büyük tehlike de tam burada: Sorgulanamaz olan bir düzen teknolojik bir konfor perdesi arkasında sessiz bir otorite kuruyor ve de biz bunun günlük hayatımızda sıradanlaşmasını çok kolay şekilde kabullenebiliyoruz. ABD’nin kurucularından olan Benjamin Franklin’in dediği gibi “Geçici ve ufak bir güvenlik için temel özgürlüklerinden feragat edenler ne güvenliği ne de özgürlüğü hak ederler.” Yani eğer kararlarımızı tamamen algoritmalara bırakır, sadece daha hızlı teslimat ya da daha iyi öneriler uğruna düşünme sorumluluğundan vazgeçersek bir gün sahip olduğumuzu sandığımız özgürlükleri kaybettiğimizi ve endişelerimizin biz farkına varmadan gerçeklere dönüştüğünü fark ettiğimizde çok geç olabilir.

Bana gelecek olursak kişisel olarak kendimi bir yapay zekâ ve makine öğrenmesi meraklısı olarak tanımlıyorum. Hem günlük hayatımda hem de profesyonel hayatımda yapay zekâ projeleri geliştirerek her alanda işlerimi kolaylaştırmak adına yapay zekadan faydalanıyorum. Çevremdekileri de yapay zekâdan faydalanmaları için destekliyor ve bu teknolojiyi kullanmaları konusunda teşvik ediyorum. Genel olarak insanların daha hızlı bir yolu varken yavaş olanı seçmeleri, bana hem emeğin israf edildiğini hem de insanların vaktinin değersizleştiğini hissettiriyor. Tüm bunlara rağmen yapay zekaya olan eleştirel bakış açısının korunması gerektiğini de düşünüyorum. Özellikle krizlere açık, kararların hayati önem taşıdığı ve hata maliyetinin yüksek olduğu lojistik sektöründe, eleştirel bilincin korunması ve sürekli yeni çözümler geliştirmeye yönelik bir bakış açısının sürdürülmesi büyük önem taşıyor.

Elbette amacım, işlerimizi hâlâ eski usullerle yürütelim ya da saatlerce verimsiz iş yüküne katlanalım demek değil; demek istediğim aslında şu: Ne geçmişte takılı kalalım ne de sadece veriye itaat ederek düşünme sorumluluğumuzu bırakalım. Yani veriye itaat ederken aklımızdan vazgeçmeyelim. Saatlerce verimsiz iş yüküyle uğraşmak da her şeyi algoritmaya teslim edip aklımızı devre dışı bırakmak da aynı ölçüde tehlikelidir. Evet, yapay zekâ rota optimizasyonu, tahmini teslimat süresi hesaplamaları, depo içi envanter yönetimi, talep tahmini, filo yönetimi gibi alanlarda insan emeğini ciddi oranda azalttı ve birçok problemi çözmekte büyük kolaylık sağladı ancak unutulmamalı ki karar verme süreçlerinin tamamıyla algoritmalara bırakıldığı bir sistemin, uzun vadeli çok daha büyük sorunlara yol açma potansiyeli vardır.

Veriye dayalı karar alma mekanizmaları, bilimsel veriler, veri analizi gibi birçok “havalı” kelime aslında veri bilimini olduğundan daha kutsal görülmesine ve bizim de daha fazla veriye itaat eksenine çekilmemize sebep oluyor. Sıklıkla dile getirilen ünlü bir deyiş vardır: “Veri asla yalan söylemez.” Ancak verinin ne söylediği kadar kimin adına konuştuğu, kimi dışarda bıraktığı ve hangi bakış açılarını susturduğu da bir o kadar önemlidir.

Belki de yakın gelecekte bir hastanede yapay zekâ destekli bir sıralama algoritması, organ nakli bekleyen hastaları “yaşam beklentisi” ve “maliyet-etkinlik” kriterlerine göre sıralayacak. 30 yaşında, düşük gelirli, kronik böbrek yetmezliği olan bir işçi ile 60 yaşında, üst düzey yönetici pozisyonunda, özel sigortalı bir hasta aynı organ için listede olacak. Algoritma, işe dönüş süresi, mevcut sağlık geçmişi ve sigorta kapsamı gibi değişkenlere göre 60 yaşındaki hastayı önceliklendirecek; çünkü onun “ekonomik değeri” ve “sistem verimliliği” daha yüksek olarak hesaplanacak ancak insani bakış açısıyla değerlendirildiğinde, bu karar hayatını yeniden kurmaya çalışan genç bir bireyin sistem dışına itilmesi anlamına gelecek. Görünüşte tarafsız, bilimsel ve veriye dayalı olan bu karar, aslında hangi hayatın daha “değerli” olduğu konusunda sessiz bir yargı taşıyacak. Bizler de bu sessiz yargıyı, yalnızca “veriye uygun” olduğu için sorgulayamayacak hâle geleceğiz.

Lojistik sektörüne de bakacak olursak sektörde kullanılan yapay zekâ sistemleri genellikle tarafsız, bilimsel ve “veri odaklı” birer araç olarak sunulsa da bu sistemler, görünürdeki nesnelliklerine rağmen belirli değer yargılarına, önceliklere ve ekonomik tercihlere göre şekillenir. “En kısa rota” ya da “maksimum verimlilik” gibi hedefler, insanî ihtiyaçları ve etik kaygıları çoğu zaman dışarıda bırakır. Örneğin, afet bölgesine ulaştırılması gereken yardımlar, sistemin maliyet algoritmasına uygun olmadığı için ertelenebilir. Bir algoritma için bu yalnızca “düşük öncelikli bir görevdir”; fakat insan için hayati bir gecikmedir. Bu nedenle, hangi alanda kullanılırsa kullanılsın, yapay zekâ sistemlerinden insan unsuru asla çıkarılmamalı; nihai kararların etik sorumluluğu daima insan aklında ve vicdanında kalmalıdır.

Bu gibi hassas konularda, yapay zekâ sistemleri yalnızca “veriye dayalı” teknik araçlar değil, meşruiyet üretim mekanizmaları hâline gelir. Kararlar artık “şirketimizin, yöneticinin kararı böyle” denilerek değil, “yapay zekâ böyle öneriyor” denilerek alınır. Bu durum, otoritenin görünüşte kaybolduğu ama aslında daha güçlü ve sorgulanamaz bir biçimde geri döndüğü bir yapıya işaret eder. Fransız düşünür Michel Foucault’nun tanımıyla, modern iktidar artık bastırıcı değil, “norm koyucu” bir iktidardır. Yapay zekâ sistemleri de bu yeni iktidar biçiminin dijital araçlarıdır: Görünüşte tarafsız, teknik ve bilimsel olan bu sistemler, aslında belirli normları dayatır, tercihleri sınırlar ve eleştiriyi akılsızlık gibi göstererek itaat üretir. Böylece teknoloji aracılığıyla kurulan bu “sessiz iktidar,” bireylerin özgür irade illüzyonunu korurken, kararları çoktan sessizce almış olur. Teknolojik gelişme kisvesi altında, toplumun her kesimi bu sistemi sorgulamadan benimsemeye başlar. Çünkü veriye dayalı olduğu söylenen her şey, “bilimsel” etiketiyle sunulduğunda karşı çıkmak aykırılık değil, akılsızlık gibi görülür. Özellikle de bu tür gelişmeler, başlangıçta “insanlık yararına” etik hedeflerle ortaya çıkan ancak zamanla kâr amacı güden ticari yapılara dönüşen şirketler tarafından tanıtılıyorsa bu etki daha da güçlenir. Nitekim OpenAI (ChatGPT’nin geliştiricisi), kuruluşunda kâr amacı gütmeyen bir vakıf olarak insanlığa fayda ilkesine bağlı kalacağını ilan etmiş; ancak daha sonra ticari ortaklıklar kurarak yatırımcı çıkarlarını önceleyen bir modele geçmiştir. Bu değişim, yapay zekâ gibi sistemlerin “tarafsız” ya da “bilimsel” görünmesinin ardında bile ekonomik ve politik çıkar yapılarını barındırabileceğini açıkça gösterir. Böylece etik, insani ihtiyaç gibi kavramlar, “verimlilik” ve “optimizasyon” gibi teknik terimlerin gölgesinde sessizce sistem dışına itilir. En tehlikelisi ise bu duruma alışmamızdır: Bu noktada tekrar Benjamin Franklin’in sözü yankılanır: Konfor için daha az hata oranına sahip optimize sistemler için (bu şirketlerin kar maksimizasyonu amacı gibi de yorumlanabilir) vazgeçilen insan aklı, bir süre sonra yalnızca insan aklının değil, tüm insani değerlere ait alanın da kaybı anlamına gelebilir. Yapay zekanın kontrolünde olan sözde tarafsız ve veriye dayalı bu düzen, itiraz etme alanını görünmez kılan bir teknopol yapıya dönüşür.

Tarih, bize otoritenin en güçlü olduğu anların, onun en görünmez olduğu zamanlar olduğunu öğretir. Roma İmparatorluğu’nda halkın, Augustus’un yönettiği bir rejimde hâlâ cumhuriyette yaşadığını sanması gibi, bugün de veriye dayalı sistemlerin yönettiği, insan psikolojisinin zayıflıklarından faydalanmayı alışkanlık haline getirmiş bir tüketim düzeninin içindeyiz ve de yakın gelecekte “istatistik motoru olan yapay zekâ” bu kararları ve çok daha hayati süreçlerdeki kararları bizim yerimize bizim haberimiz bile olmadan alabilecek. Roma’da cumhuriyetin sona erip imparatorluk düzenine geçildiği ilk yıllarda, halk hâlâ forumlarda toplanıyor, senato ise görevini sürdürüyor gibi bir görüntü sergiliyordu. Ancak artık kararlar, görünürdeki kurumlar değil, Augustus otoritesinin sessiz ama mutlak iradesi (veriye dayalı olduğu için itiraz etmenin akılsızlık olarak kabul edildiği mutlak bir yapay zekâ iradesi gibi) tarafından veriliyordu. Bugün de benzer bir yanılsamanın içindeyiz: Belki de ilerleyen yıllarda, kaçınılmaz olarak yapay zekâ neyin bizim için en verimli, neyin en iyi olduğuna karar verecek; bizler de bu kararlara yalnızca saygı duyup, insansızlaştırılmış süreçleri sorgulamadan uygulamaya devam edeceğiz.

Sonuç olarak bu koşullarda lojistik açısından sormamız gereken soru nettir:

Yapay zekâ sistemimiz bize mi hizmet ediyor, yoksa biz mi sistemin rotasına dahil edilmiş birer taşıyıcıya dönüştük?

İşte bu noktada, lojistik sektörünün bütün paydaşlarına ileride büyük bir sorumluluk düşecektir. Karar alma süreçlerinde algoritmalara körü körüne güvenmek yerine, bu sistemlerin etik sınırlarını çizecek olan yine insan aklı, sezgisi ve sorumluluğu olacaktır. Çünkü bir sistemi sadece veriye göre yönetmek, kısa vadede “verimlilik” getirirken; uzun vadede insan aklını, vicdanını ve öngörüsünü sistem dışı bırakmak anlamına gelir.

Her bir lojistik faaliyet, yalnızca mal taşımakla kalmaz aynı zamanda karar taşır. Ve bu kararların sorumluluğu, veriye değil, hâlâ bizlere aittir. Alman düşünür Hans Jonas’ın ifadesiyle, teknolojik gücün büyüdüğü ölçüde insanın sorumluluğu da büyür. Lojistik gibi hayati sektörlerde de algoritmalar yalnızca hesaplar sunabilir, ama kararın yükünü yine biz taşımalı ve sorgulamaya devam etmeliyiz. Depolardan veri merkezlerine, rota çizimlerinden acil yardım dağıtımlarına kadar tüm aşamalarda, yalnızca en hızlı veya en ucuz olanı değil; en doğru, en insani ve en adil olanı da gözetmek eskiye nazaran hiç olmadığı kadar zorunludur ve bahsettiğim akılsızlık düşüncesi nedeniyle daha da zor hale gelecektir.

En korkutucu olan ise, bu sistemin sorgusuzca kabul edileceği o gün geldiğinde artık hiç kimsenin bu soruyu sormayı aklından bile geçirmeyecek olmasıdır. Belki bir gün yapay zekâ, bizim adımıza karar verirken biz hâlâ kendimizi karar veriyor sanacağız. Belki algoritmalar, insanî duygularımızı etik düşüncelerimizi zayıflık olarak nitelendirip dışlarken biz bunu “ilerleme” diye alkışlayacağız. Tedarik zincirleri içinden insanın çıkartıldığı şekilde sessizce işlerken, bizler birer veri noktası, birer koordinat, birer paket gibi davranmayı içselleştirmiş ve de tek önemsediğimizin daha fazla optimizasyon olduğu bireyler olacağız ve işte o zaman, aklın yerini verimlilik, sezginin yerini tahmin, vicdanın yerini optimizasyon alacak. Belki de en sarsıcı olan şu olacak: Bir sabah, hiçbir şey olmamış gibi uyanacağız. Tedarik zincirleri sessizce işleyecek, teslimatlar zamanında yapılacak, rotalar kusursuzca çizilecek, sistem tıkır tıkır çalışıyor olacak. Ama o gün, en temel soruyu artık kimse sormayacak: “Bu karar gerçekten bana mı ait?” Çünkü düşünmenin zahmeti, sorgulamanın yalnızlığı ve yavaşlamanın maliyeti bizi algoritmalara teslim etmiş olacak. Oysa insan olmak, her zaman en doğruyu bilmek değil; neyin doğru olduğuna karar verecek cesarete sahip olmaktır. Eğer bu cesareti veriye devredersek, geriye sadece hız kalır ama yön kalmaz.

İşte tam da bu yüzden, aklımızı yalnızca karar vermek için değil, karar vermeye hakkımız olduğunu hatırlamak için korumalıyız. Çünkü veri hesaplar; ama sorumluluk hâlâ insana aittir.